Ieri la Commissione Europea ha presentato una proposta di Regolamento per l’Intelligenza Artificiale (AI) che sottolinea i rischi della sorveglianza biometrica di massa, e propone una nuova regolamentazione per vietare l’uso da parte delle forze dell’ordine di alcune di queste tecnologie —un piccolo passo nella giusta direzione.

In particolare, siamo lieti di vedere che la Commissione riconosca che la sorveglianza biometrica di massa ha un impatto altamente invasivo sui diritti e le libertà delle persone, così come il fatto che l’uso di queste tecnologie possa “influenzare la vita privata di una grande parte della popolazione ed evocare una sensazione di sorveglianza costante (…)“. Questi sono esattamente i motivi che hanno spinto la coalizione Reclaim Your Face a battersi per vietare la sorveglianza biometrica con una campagna pubblica, e dimostra che i nostri punti hanno colpito nel segno.

Purtroppo, però, siamo delusi perché la proposta odierna non fa abbastanza per proteggere le persone da molteplici tipologie di sorveglianza biometrica di massa che abbiamo già visto in azione in Europa. Come risultato la proposta si contraddice, permettendo alcune forme di sorveglianza biometrica di massa che però riconosce essere incompatibili con i nostri diritti fondamentali e con le libertà protette in Europa!

In particolare, la proposta vieta “l’identificazione biometrica da remoto” in “real-time” per finalità di sicurezza. Eppure, riteniamo ci siano ancora grossi problemi:

- La formulazione è spesso vaga e contiene diversi elementi definiti in maniera poco precisa, lasciando ampio spazio di interpretazione e discrezione. Ciò riproduce molti dei problemi già esistenti nelle leggi sulla protezione dei dati personali che ci hanno portato a chiedere un divieto esplicito;

- Il divieto si applica solo alle forze dell’ordine, ma non proibisce usi altrettanto invasivi e pericolosi da parte di altre autorità governative e di aziende private, che costituiscono comunque una sorveglianza biometrica di massa;

- Il divieto per le forze dell’ordine presenta molte eccezioni definite in modo troppo ampio e che quindi potrebbero seriamente minarne lo scopo. In questo modo si lascia ampio spazio per una sorveglianza biometrica di massa continuativa dello spazio pubblico da parte delle autorità di polizia;

- È vietata solo l’identificazione in “real-time” a fini di sicurezza. È quindi ancora possibile identificare persone dopo che le immagini sono state registrate (il riferimento nel regolamento a “post”, quindi dopo che un evento è avvenuto)—ciò vuol dire, per esempio, che la polizia potrebbe ancora usare il database di Clearview AI;

- Tutte le altre pratiche di identificazione biometrica—inclusa quella spesso considerata psuedo-scientifica e altamente discriminatoria della “categorizzazione” biometrica—non sono vietate dalla proposta.

La coalizione Reclaim Your Face, composta al momento da 60 associazioni e gruppi che si occupano di diritti umani digitali e di giustizia sociale in tutta Europa, è nata a ottobre 2020 proprio per opporsi alla sorveglianza biometrica di massa in Europa. La coalizione ha sottolineato che questa pratica è invasiva, discriminatoria e antidemocratica.

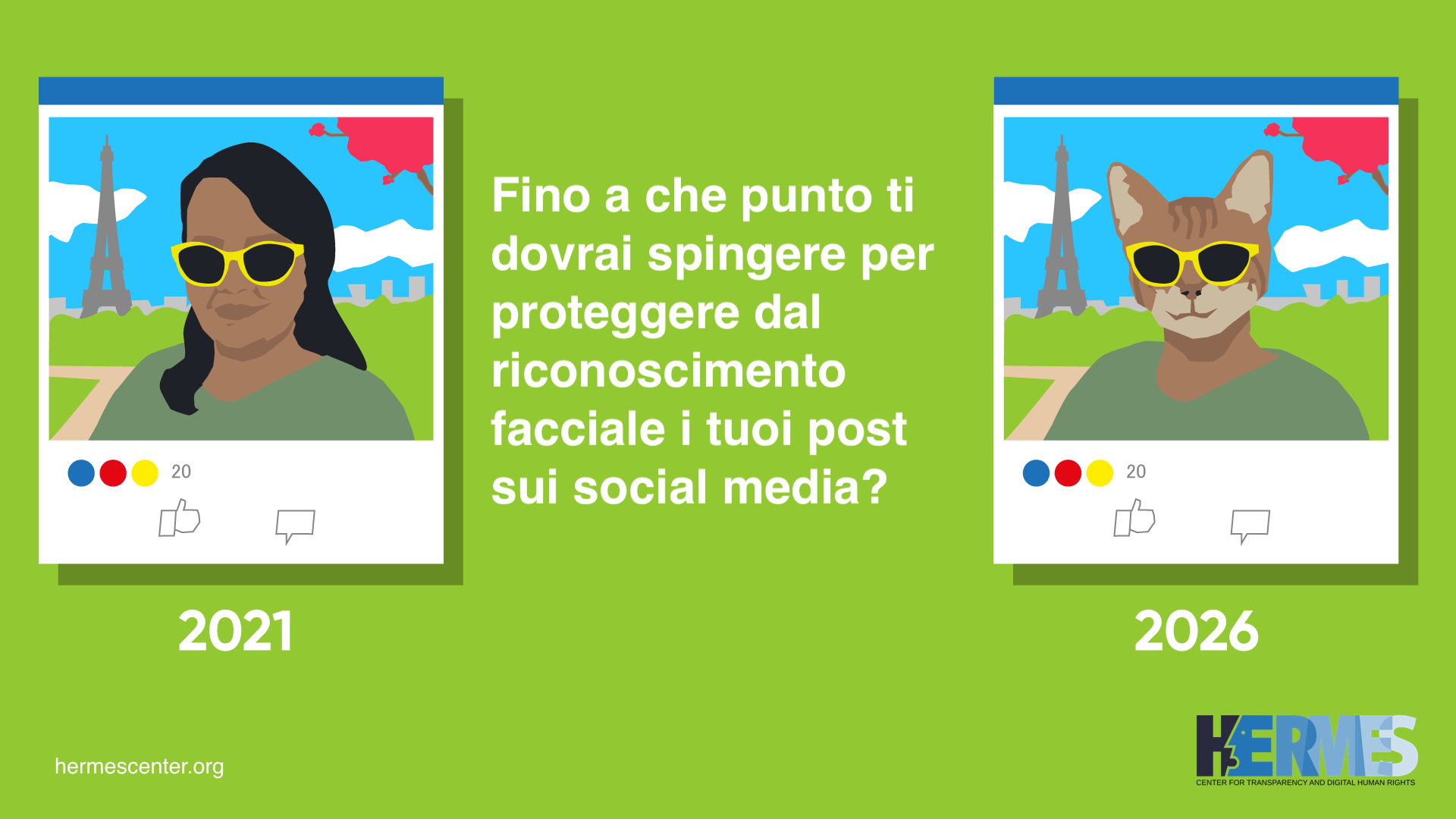

Se l’Europa non vieterà la sorveglianza biometrica, il rischio di sorveglianza di massa nelle nostre città sarà estremamente reale. La tecnologia non può avere il potere di definire chi siamo, nè di controllarci. Privacy significa potere. Reclamare il possesso delle nostre città e degli spazi pubblici è il primo step per riappropriarci della nostra faccia.

Laura Carrer – Hermes Center for Transparency and Digital Rights

Dal riconoscimento facciale nei parchi e nelle scuole, alla biometria “intelligente” per sorvegliare i manifestanti, fino alla sorveglianza sistemica e oppressiva di gruppi emarginati della popolazione, per noi non c’è posto nelle nostre società per tecnologie biometriche che ci trasformano tutti in sospetti criminali. Le prove raccolte dalle nostre associazioni hanno rivelato che gli attuali abusi sono vasti e sistemici, e la nostra analisi ha dimostrato che l’unico modo per proteggere i diritti delle persone in Europa è quello di vietare queste pratiche. Non dovremmo essere costretti a guardarci le spalle ovunque andiamo.

Qui c’è l’analisi iniziale di EDRi sull’intera proposta di Regolamento— incluse le preoccupazioni per altri casi d’uso che sarebbero dovuti essere vietati ma così non è stato – e disposizioni che permettono a chi sviluppa sistemi di AI di farsi una auto-valutazione.

Per firmare la petizione: https://reclaimyourface.eu/it/